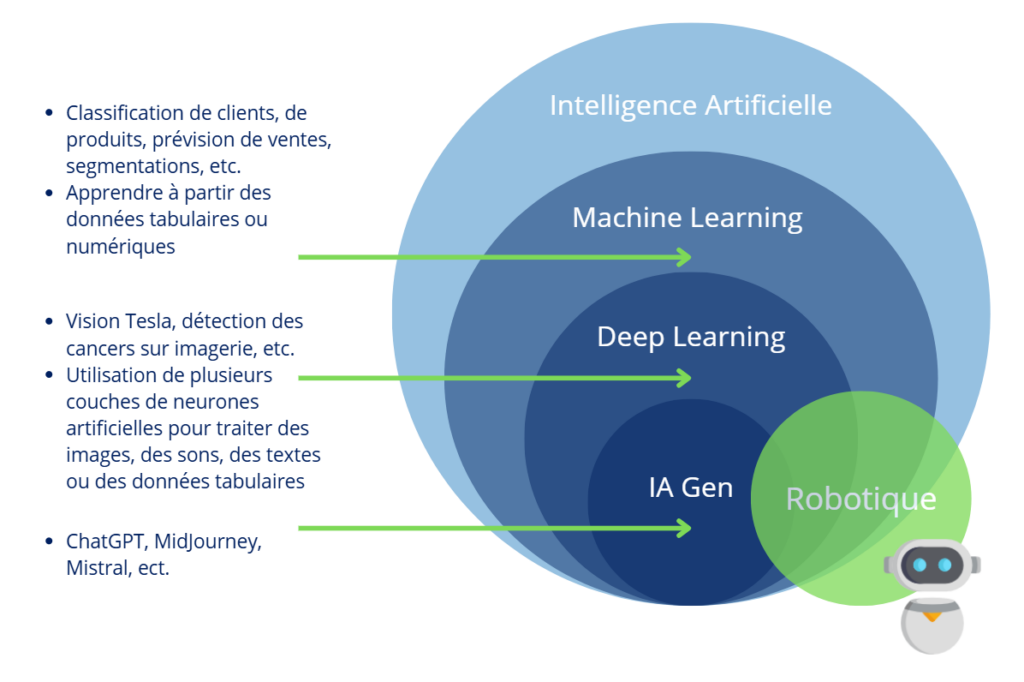

Avec la démocratisation de l’IA dans la vie professionnelle et personnelle, de nombreux nouveaux termes sont apparus : Deep Learning, LLM, IA génératives, …. Ils peuvent parfois être difficiles à appréhender et surtout à différencier. À travers cet article, nous proposons de lever le voile sur ces termes, d’en expliquer le sens et de montrer comment ils s’articulent les uns avec les autres.

Intelligence artificielle (IA)

Pour commencer, l’intelligence artificielle désigne la discipline qui vise à créer des programmes capables d’imiter des comportements intelligents. Dans les faits, il s’agit généralement de programmes dont la tâche est d’effectuer des actions habituellement faites par des humains. Ce terme est très généraliste et recouvre de nombreuses sous-catégories.

Machine Learning

Le machine learning est un sous-domaine de l’IA où les algorithmes apprennent à partir de données au lieu d’être programmés explicitement, contrairement à un ensemble de règles ou à des modèles statistiques classiques.

Parmi les algorithmes de Machine Learning les plus couramment utilisés, on peut citer : les arbres de décisions, les Random Forest, le Gradient Boosting ou encore les réseaux de neurones.

Réseaux de neurones et Deep Learning

Ces modèles sont inspirés du cerveau humain et sont composés de neurones artificiels connectés entre eux. Ils sont particulièrement populaires pour traiter des gros volumes de données et des dépendances complexes. Avec l’augmentation des capacités de calculs observée ces dernières années, leur complexité s’est accrue. Ainsi, on a vu se développer des réseaux comportant de nombreuses couches et de très grande profondeur. Les modèles utilisant ces structures complexes sont appelés modèles de Deep Learning. Ils sont qualifiés de « boite noire », car l’interprétation des modèles et l’explication de leurs prédictions est complexe voire impossible.

Transformers

Les Transformers sont une architecture de réseaux de neurones qui utilisent l’auto-attention pour traiter du texte ou des images de manière parallèle. À chaque mot, la représentation vectorielle de celui-ci est calculée en prenant en compte chacun des autres mots du textes afin de pouvoir tenir compte du contexte lors de la vectorisation. Développés par Google en 2017, les Transformers ont révolutionné le traitement automatique de texte en permettant d’améliorer les performances sur de nombreuses tâches.

IA générative

L’IA générative (parfois abrégée en IAGen) est la branche de l’IA qui consiste à créer du nouveau contenu tel que du texte, de l’image, de la musique… Avec la démocratisation des IA grand public telles que ChatGPT, Mistral, Claude, etc. l’IA générative est devenue l’image de l’IA auprès des utilisateurs.

LLM

Les LLM (pour Large Language Models) sont les modèles de base utilisés dans les IA génératives récentes. Ils sont basés sur des Transformers. Composés de milliards de paramètres, ils sont capables de rédiger des textes mots par mots afin de répondre à la demande de l’utilisateur.

Pour résumer cet article, le schéma suivant présente les liens existants entre les différentes notions abordées.

Rendez-vous la semaine prochaine pour un nouvel article !